Nate Silver est un statisticien brillant spécialisé dans les résultats du baseball… et les élections politiques.

En 2008, il prédit les résultats corrects des élections américaines dans 49 états sur 50. En 2012, il réalise un sans faute ! Le Monde vient de lui consacrer un article à l’occasion de sa conférence à LONDRES sur le Big Data.

Cette expression anglophone désigne des ensembles de données tellement volumineux qu’ils sont presque impossibles à travailler pour le commun des mortels. Ceux qui peuvent interpréter les données à leur disposition détiennent un avantage.

1/ Préférer les données à son instinct !

Pour quelqu’un d’extérieur, ce travail scientifique et rationnel sur les données peut apparaitre comme empreint de magie ou relevant de la voyance. Un peu comme une première place sur Google. Les articles reliant le SEO au Big Data commencent d’ailleurs à fleurir. Car le travail de Google et des autres moteurs justement, c’est d’analyser les centaines de millions de sites Internet pour décider lequel correspond le mieux à la requête de l’utilisateur.

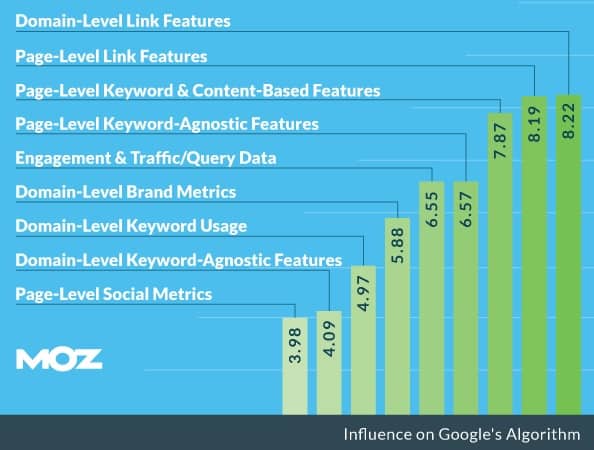

Le référenceur, l’analyste SEO est au bout de la chaine ; il étudie les résultats des moteurs, les études et les données d'outils comme Search Console, Analytics, SEMrush etc., pour déterminer :

- Les facteurs déterminants dans les classements à chaque mise à jour de l’algorithme.

- La compétitivité d’une requête.

- La possibilité de se positionner dessus d’après son budget/son temps.

Cela me rappelle un extrait du site SEOLIUS, mis à l’honneur dans un article de Laurent Bourelly : Notre équipe possède une clairvoyance et une très grande expérience nous rendant capables d’anticiper les changements dans les algorithmes de Google basé sur des fuites, des news venant de Google et par le partage entre partenaires et concurrents du secteur.

Vous noterez qu’il est justement question de clairvoyance, de capacité à prédire l’avenir.

2/ Expliquer son travail, loin d'être magique.

A l’inverse, un référenceur responsable fera preuve de pédagogie et de transparence en exposant sa méthode et les risques pris. Prenons le cas d’une PME qui souhaite se positionner dans les 10 premiers sur « salade de fruits ». Le premier résultat, « salade-de-fruits.com » :

- - Bénéficie de 5 000 liens depuis 18 domaines; 17 ancres portent la mention exacte ou partielle « salade de fruits », dont 1 tiers en nofollow.

- - Cela se traduit par une autorité de domaine de 21 et une autorité de page de 34, pour un PageRank 2.

- - Compte 10 pages indexées dans Google, 41 G+1, 128 j’aime (ça cartonne socialement la salade de fruits ;)).

Au final, il y a un peu de compétition mais rien d’insurmontable : 42% de difficulté d’après MOZ. D’après ce premier constat, il est possible de mettre en place un plan d’attaque, d’estimer un nombre d’heures et un coût prévisionnel.

Un site étoffé, avec un bon netlinking et quelques partages sociaux devrait logiquement arriver en première page. Mais à quelle position ? Dans quel délai ?

Nate Silver rappelait « Il y a 80 % de chances qu’Obama remporte l’élection. Les 20 % représentent la dose d’incertitude inhérente à la réalité. »

En 2016, il s'est planté (comme presque tout le monde) avec Trump !

La même logique s’applique aux algorithmes des moteurs de recherche : il n’y a jamais de certitude absolue d’obtenir le résultat escompté. Une première position par contre, ne doit jamais rien au hasard :).

« SEO isn’t Magic » titrait le Blog Moz en mai 2012 : il n'y a pas de réel secret, juste du travail !

3/ Un exemple de référencement concret avec cet article : les erreurs 404.

En 2018, alors que je regardais les articles du blog pour voir ce qui méritait d'être mis à jour ou supprimé, je me suis aperçu que cet article n'était plus indexé par Google.

La page de l'article figurait dans la liste "explorée, non indexée" de Search Console : aucun internaute ne pouvait donc y accéder depuis les moteurs de recherche :

Depuis le blog, comme c'était un des articles les plus anciens, il fallait de nombreux clics pour y accéder. Son trafic était donc de 0.

D'où l'intérêt pour tout site, blog ou E-commerce, de faire un point régulier sur les pages qui ne captent aucun visiteur en 1 ou 3 mois par exemple.

- Soit elle est indexée mais son intérêt est nul par rapport aux recherches des internautes.

- Soit elle n'est pas indexée car Google la juge sans intérêt pour l'internaute : peu de texte ou pas d'originalité (copié/collé), problème technique ou de sécurité... ou erreur 404 comme c'était le cas pour l'article présent avant correction. En effet, l'article citait diverses sources modifiées depuis sa première publication en 2013.

La technique qui consiste à faire un point régulièrement sur son contenu, articles ou pages, s'appelle le content pruning.

Il ne s'agit de pas décider arbitrairement, au feeling, qu'une page doit être améliorée ou supprimée. Comme d'habitude en SEO, il faut partir de la data.

L'article de MOZ qui fait référence en la matière, pruning your e-commerce, retient 4 critères, à mon avis cumulatifs :

Une page qui ne possède aucun de ces 4 atouts peut quitter votre site sans que personne ne la regrette jamais.

Dès qu'une page possède un lien, génère un visiteur par mois ou une vente par an (par exemple), il vaudra mieux la laisser en place dans un premier temps.

Pour conclure : depuis sa mise à jour en 2018 et la suppression des 404, l'article est à nouveau indexé par Google :].